L’ère des simples “chatbots” conversationnels évolue rapidement vers celle des systèmes agentiques. Pourtant, une idée reçue persiste dans l’industrie : celle du “prompt magique” prêt à être copié-collé, capable de transformer n’importe quel grand modèle de langage (LLM) en un expert omniscient en quelques mots.

En réalité, si vous utilisez l’intelligence artificielle générative pour des tâches complexes ou professionnelles, les directives basiques telles que “Agis comme un expert en géopolitique” montrent très vite leurs limites fondamentales. Cet article détaille les techniques avancées de structuration de contexte pour exploiter véritablement la puissance de l’IA (comme l’écosystème Google Gemini et ses fenêtres de contexte ultra-larges de 1 à 2 millions de tokens), en passant d’un simple dialogue à une véritable orchestration de l’information.

Pourquoi les Prompts Classiques Échouent-ils ?

Pour comprendre comment formuler une requête complexe, il faut analyser la manière dont les LLM traitent l’information. Ces systèmes ne “réfléchissent” pas au sens humain du terme ; ils évaluent des relations mathématiques et calculent des distances vectorielles entre les concepts (ce que l’on nomme les clusters sémantiques)1.

Le Piège des “Distracteurs” et le “Rot Context”

Lorsque vous rédigez un prompt sous forme d’un long paragraphe narratif classique, vous y insérez sans le vouloir des éléments de contexte superflus ou des formulations floues. En ingénierie de prompt, on appelle cela des distracteurs.

Des recherches sur l’architecture et l’inférence des modèles montrent que l’ajout de seulement quatre à cinq distracteurs (informations parasites ou de faible similarité sémantique) peut dégrader la compréhension globale du contexte par l’IA de manière significative. Le modèle disperse ses “blocs d’attention” logicielle et perd le fil de la logique principale : c’est ce que les experts appellent le pourrissement du contexte (context rot)2.

L’Illusion de l’Expertise Déclarative

Dire à une IA “Tu es un expert mondial en analyse de marché” ne lui octroie pas de capacités de réflexion supérieures si vous lui fournissez ensuite 50 pages de données brutes sans méthodologie. Sans une structure claire lui indiquant comment relier les informations entre elles, l’IA va simplement générer du texte fluide, mais potentiellement faux (hallucination), car elle n’a pas pu cartographier l’arbre de décision complexe inhérent à la tâche.

Techniques de Structuration Avancées

Pour passer au niveau de l’ingénierie professionnelle, vos invites (prompts) doivent emprunter aux principes fondamentaux du développement logiciel.

1. La Structuration en XML Simplifié et Markdown

Face à une consigne contenant de nombreuses variables ou des documents annexes, le format texte pur est obsolète. Les meilleures pratiques exigent d’utiliser une structure de balises (de type XML simplifié) combinée à la hiérarchisation du Markdown. Cela permet au modèle de compartimenter son système d’attention avec une précision redoutable.

Exemple de structure recommandée :

<contexte>

Insérez ici les données factuelles, les variables chiffrées et l'environnement strict de la tâche.

</contexte>

<objectif>

Définissez l'action précise attendue et la finalité.

</objectif>

<instructions>

- Étape 1 : Analyser la [variable_A]

- Étape 2 : Comparer avec la [variable_B]

- Étape 3 : ...

</instructions>

<contraintes>

Précisez le format de sortie, le ton professionnel, et les limites à ne pas franchir.

</contraintes>Cette compartimentation garantit que le modèle traite les relations logiques bloc par bloc, réduisant drastiquement le risque de confusion sémantique.

2. Le Test de l’Arbre Décisionnel

Comment s’assurer que l’IA a parfaitement assimilé les règles de votre requête avant qu’elle ne commence à produire un long document ? En la forçant à expliciter sa propre logique de réflexion.

La technique : Ajoutez, à la fin de vos instructions, une directive exigeant la génération préalable d’un algorithme de pensée.

“Avant de générer la réponse finale, crée une représentation sous forme d’arbre décisionnel (dans un bloc de code Markdown) illustrant comment tu as compris les relations entre les blocs de variables et la logique que tu vas appliquer.”

Si le modèle restitue une structure logique cohérente, vous obtenez la preuve technique que le prompt est mathématiquement bien intégré. S’il se contente de lister vos paragraphes, c’est que votre requête est mal formulée.

Devenir Agentique : L’Architecture Parent / Sous-agents

Que se passe-t-il si la tâche est titanesque, et nécessite une planification détaillée avec un raisonnement complexe étendu ? Même le meilleur prompt du monde inséré dans la meilleure IA actuelle avec le mode “Extended Thinking”3 finira par saturer. La véritable innovation réside dans le déploiement d’une architecture agentique.

Au lieu de demander à une seule instance de tout faire simultanément, le processus doit être découpé via un workflow automatisé :

- L’Agent Parent (Orchestrateur) : Il reçoit la problématique globale. Sa seule mission est de comprendre l’objectif final, de diviser le travail et de déléguer les étapes.

- Les Sous-agents (Spécialistes) : L’Agent Parent invoque des instances séparées dotées de micro-contextes isolés. L’un extrait des tableaux de données, un autre procède aux calculs statistiques, etc.

- La Synthèse : Les Sous-agents renvoient leurs résultats formatés au Parent, qui se charge de compiler le livrable final.

Cette approche élimine totalement la dégradation cognitive du modèle et transforme des heures de recherche fastidieuse en quelques minutes de traitement automatisé, tirant parti de la puissance des modèles capables de traiter jusqu’à 2 millions de tokens comme Google Gemini 1.5 Pro.

Cas Pratique : Repenser un Prompt du Quotidien

Illustrons cette théorie avec une situation courante : la préparation d’un argumentaire pour une négociation professionnelle (ex: évolution salariale ou tarifaire).

❌ L’approche classique (Inefficace) :

“Je suis un développeur avec 4 ans d’expérience. Je gagne 42k et le marché est autour de 50k. J’ai un entretien dans 2 semaines. J’ai déployé un système qui a augmenté les conversions du site e-commerce de 23% cette année. Mon manager est plutôt à l’écoute mais va me dire que le budget est serré. Aide-moi à négocier.”

Ici, l’information est narrée. Des éléments comme “J’ai un entretien dans 2 semaines” agissent comme des distracteurs purs qui n’ont aucune utilité pour l’argumentation elle-même.

✅ L’approche structurée (Agentique) :

<contexte>

- Rôle actuel : Développeur Web (4 ans d'expérience professionnelle).

- Rémunération actuelle : 42 000 €.

- Rémunération marché constatée : 48 000 € à 55 000 €.

- Réalisations clés de l'année : Déploiement d'une solution technique ayant généré +23% de conversions e-commerce.

</contexte>

<objectif>

Générer un argumentaire de négociation structuré visant à aligner la rémunération sur le marché, en s'appuyant exclusivement sur les preuves de rentabilité (ROI).

</objectif>

<objections_anticipees>

- Objection principale du manager : "Le budget du département est bloqué cette année."

</objections_anticipees>

<instructions_de_traitement>

1. Analyse l'écart entre le marché et la situation actuelle.

2. Formule 3 arguments basés sur l'impact business généré.

3. Rédige un script de réponse spécifique (stratégie de contournement) à l'objection budgétaire identifiée dans la section <objections_anticipees>.

4. Impératif : Avant de rédiger l'argumentaire complet, affiche ton arbre décisionnel montrant ta stratégie de réponse.

</instructions_de_traitement>Avec cette ingénierie rigoureuse, l’IA ne présume rien, ne se disperse pas, et cible parfaitement chaque contrainte avec une précision “chirurgicale”.

Conclusion

Le Prompt Engineering moderne s’est éloigné de l’art du “chat” intuitif pour devenir une véritable discipline d’architecture de l’information. Maîtriser le XML simplifié, éliminer le bruit cognitif, imposer des vérifications d’arborescence et savoir scinder les tâches en architectures agentiques sont aujourd’hui les compétences indispensables pour exploiter tout le potentiel de l’Intelligence Artificielle. Ce n’est plus de la magie, c’est de l’ingénierie logicielle.

Notes de bas de page

-

Les LLMs (Large Language Models) utilisent des architectures de type Transformer pour cartographier les relations probabilistes entre les “tokens” (mots ou fragments de mots). ↩

-

Le “Context Rot” (ou dégradation du contexte) survient lorsque la fenêtre de contexte d’un modèle est saturée d’informations non pertinentes, ce qui dilue l’attention du modèle et augmente le risque d’hallucinations. ↩

-

Le mode “Extended Thinking” (ou raisonnement étendu) permet à des modèles comme Gemini Advanced de traiter et réfléchir sur des problèmes complexes en allouant plus de ressources de calcul (compute-optimal inference) avant de générer une réponse. ↩

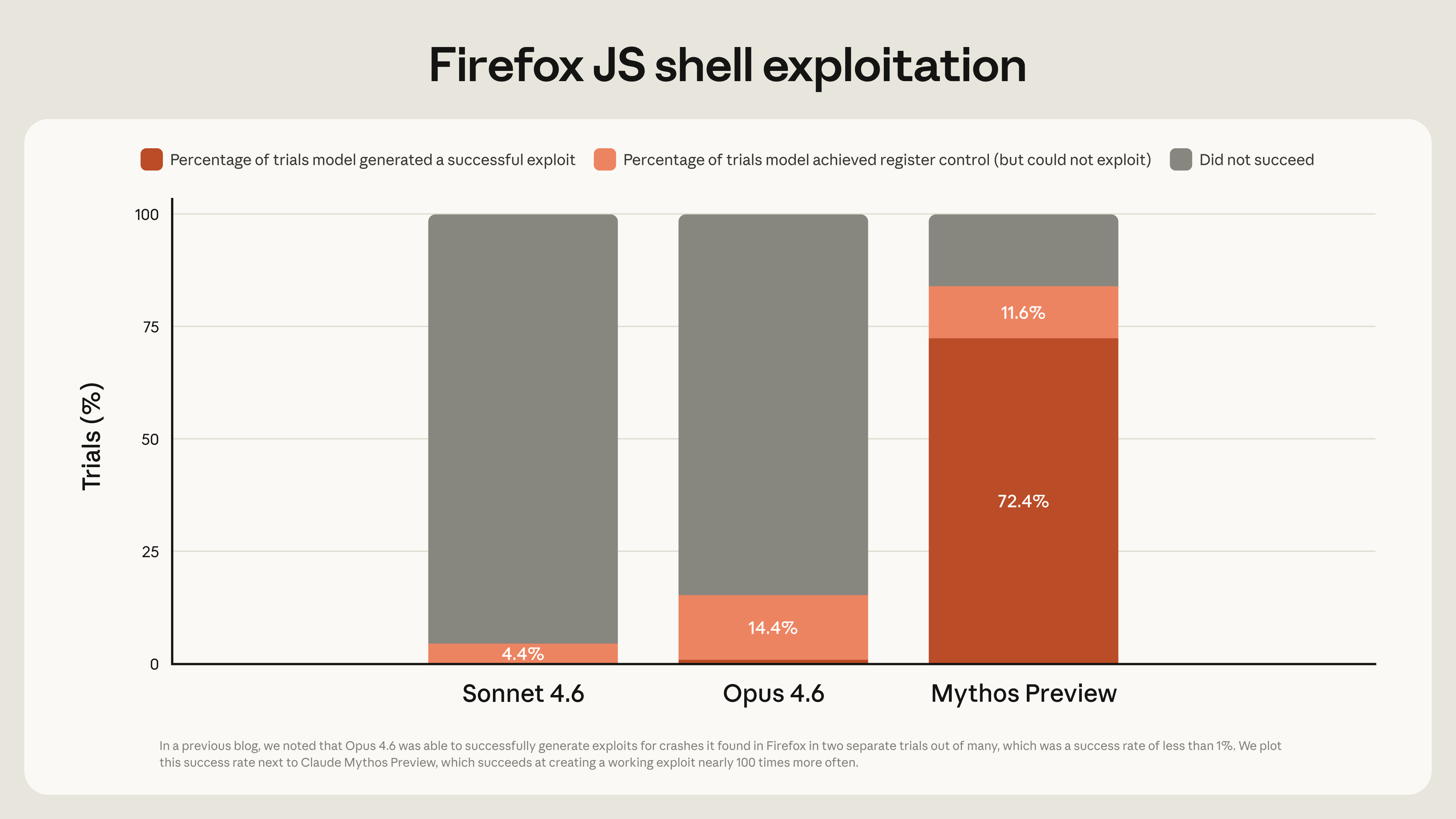

Claude Mythos : Une révolution pour la cyberséc...

Claude Mythos : Une révolution pour la cyberséc...

Mises à jour majeures de Google Gemini : Modèle...

Mises à jour majeures de Google Gemini : Modèle...